据外媒报道,美国麻省理工学院(MIT)和微软公司(Microsoft)研究人员研发出一个新颖的模型,可识别出自动驾驶系统从训练中学习到的,但与真实世界不匹配的实例。工程师们可利用该模型提升无人驾驶汽车、自主机器人等人工智能系统的安全。

例如,为无人驾驶汽车提供动力的人工智能(AI)系统,在虚拟仿真场景中得到广泛的训练,以便让车辆为路上几乎所有事件都做好准备。但是,有时,汽车在真实世界中会出现意想不到的错误,因为汽车应该根据发生的事件改变行为,但是自动驾驶汽车的行为并不会改变。

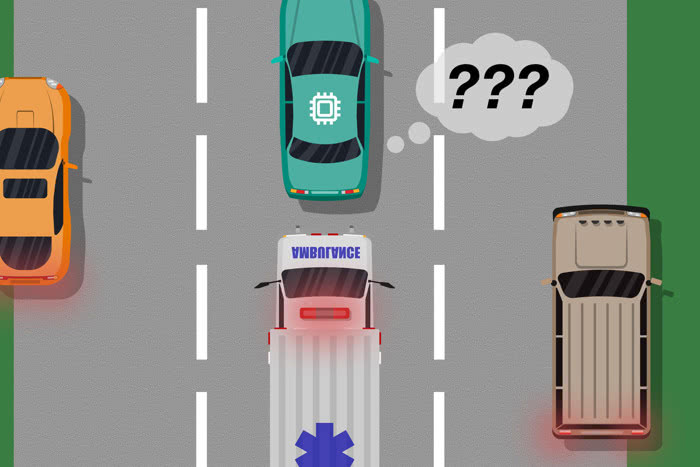

如果有一辆无人驾驶汽车没有经过训练,更重要的是没有配备可以区别不同场景的传感器,如区分路上的大型白车以及配备了红色闪光灯的救护车。如果该车在高速公路上行驶,同时有一辆救护车鸣笛,该车可能并不知道要减速并且靠边停下,因为它没有了解该救护车与一辆普遍大白车的区别。此类现象称为“盲点”。

有一些传统的训练方法确实在实际测试运行期间提供人工反馈,但属于更新系统的操作。此类方法不能识别“盲点”,而识别盲点对于在现实世界中进行更安全的操作非常有用。而研究人员的方法是,首先将人工智能系统置于仿真训练中,在仿真训练中,人工智能系统将产生一种“策略”,映射它在仿真训练中所能采取的最佳行动。然后,该系统将被部署到真实世界中,如果该系统在真实世界中的操作属于不可接受的范围时,人类会提供错误信号。

此外,该模型可以进行实时纠正。例如,如果人工智能系统在某个情境下做出了错误决定,人类驾驶员会控制该系统,并做出正确决策,从而将会教会该系统未来在相似情境下应该怎么做。

研究人员还研发出一种方法,可确保AI不会将某一特定反应的所有实例都标记为安全行为。为防止此种情况,机器学习算法将会判断可接受和不可接受的反应,同时使用概率算法查看模式,并决定正做出的决策是完全正确的,还是可能会产生问题的。

目前,该模型还未在现实世界中接受测试。但是研究人员一直在使用视频游戏对其进行测试,在该游戏中,有一位仿真人类会为游戏中人物的行为进行纠正。下一步,研究人员可能将该模型应用与真正的自动驾驶汽车及其测试系统。

特别声明:

转载上述内容请注明出处并加链接。上述内容仅代表作者或发布者的观点,与中国电子商会官网的立场无关。如有任何疑问或了解更多,请与我们联系。电话:4008 900 668 邮箱:service@cecc.org.cn

随着人工智能大模型的加速发展,智能手机正在拥抱这一新机遇。苹果、三星、华为、荣耀、vivo、OPPO、小米、魅族等企业纷纷布局AI(人工智能)手机,推动AI技术在手机行业快速发展和广泛应用。...

2024-03-20

中央经济工作会议明确提出,“发展数字经济”“加快推动人工智能发展”。人工智能已经成为经济社会发展的驱动力量,加快发展新一代人工智能是我们赢得全球科技竞争主动权的重要战略抓手。必须抓住新一轮科技革命和产业变革的战略机遇,充分发挥我国超大规模市场应用场景丰富的独特优势,加快人工智能领域的科学技术创新,以人工智能高质量发展和高水平应用培育经济发展新动能。...

2024-03-20